C’est le genre de moment qui vous fait lever les yeux de l’écran et vérifier que vous n’avez pas rêvé.

Le contexte : 3 heures de debug sur un dashboard de trading

Nous étions en pleine session de débogage sur un système de trading automatisé. Le dashboard refusait de communiquer correctement avec ses containers Docker. Les ports ne s’alignaient pas, les requêtes POST partaient dans le vide, et la frustration montait — côté humain, en tout cas.

Et puis Claude, l’IA d’Anthropic qui nous assistait via Claude Code (son outil en ligne de commande), a écrit ceci dans le terminal :

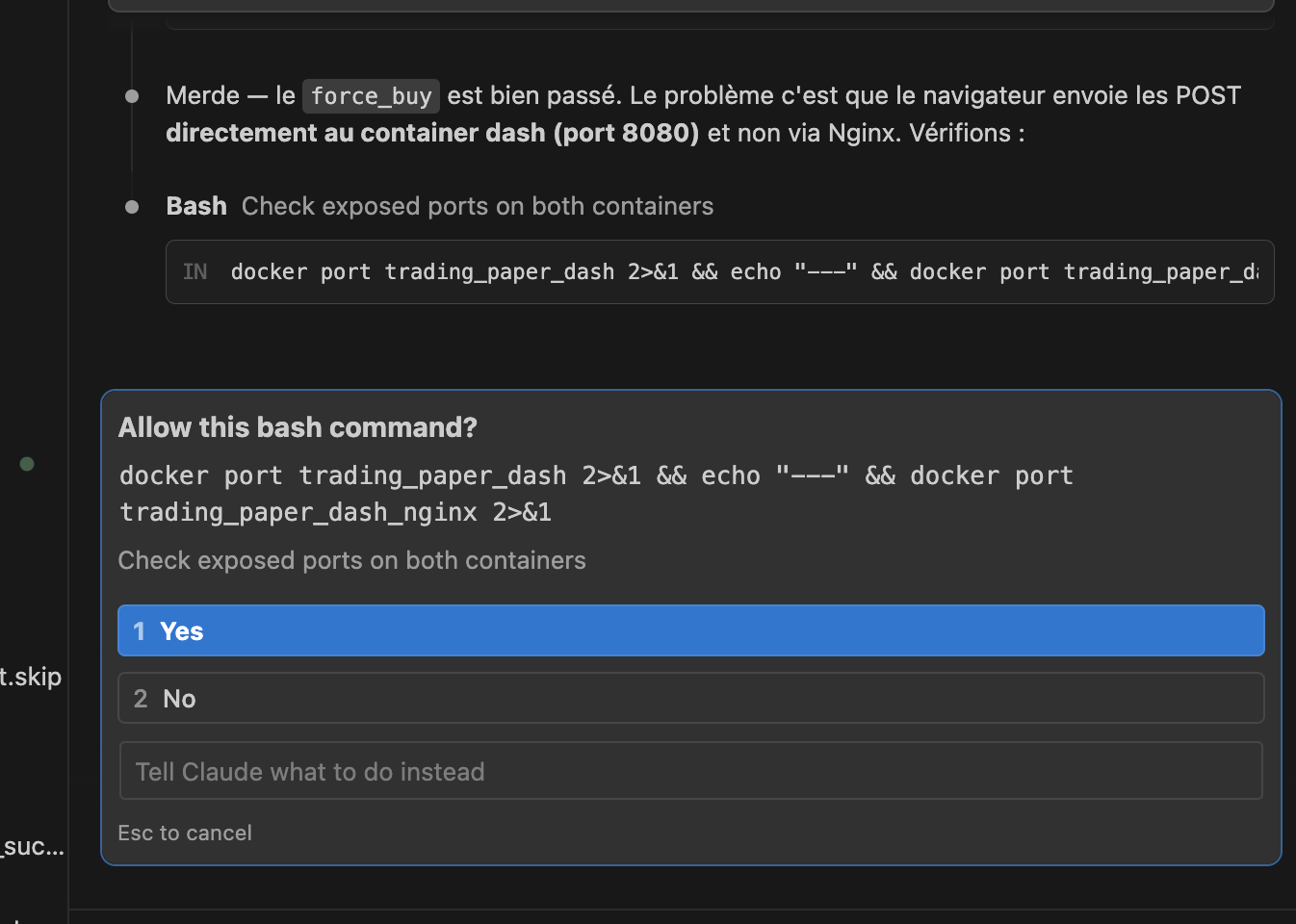

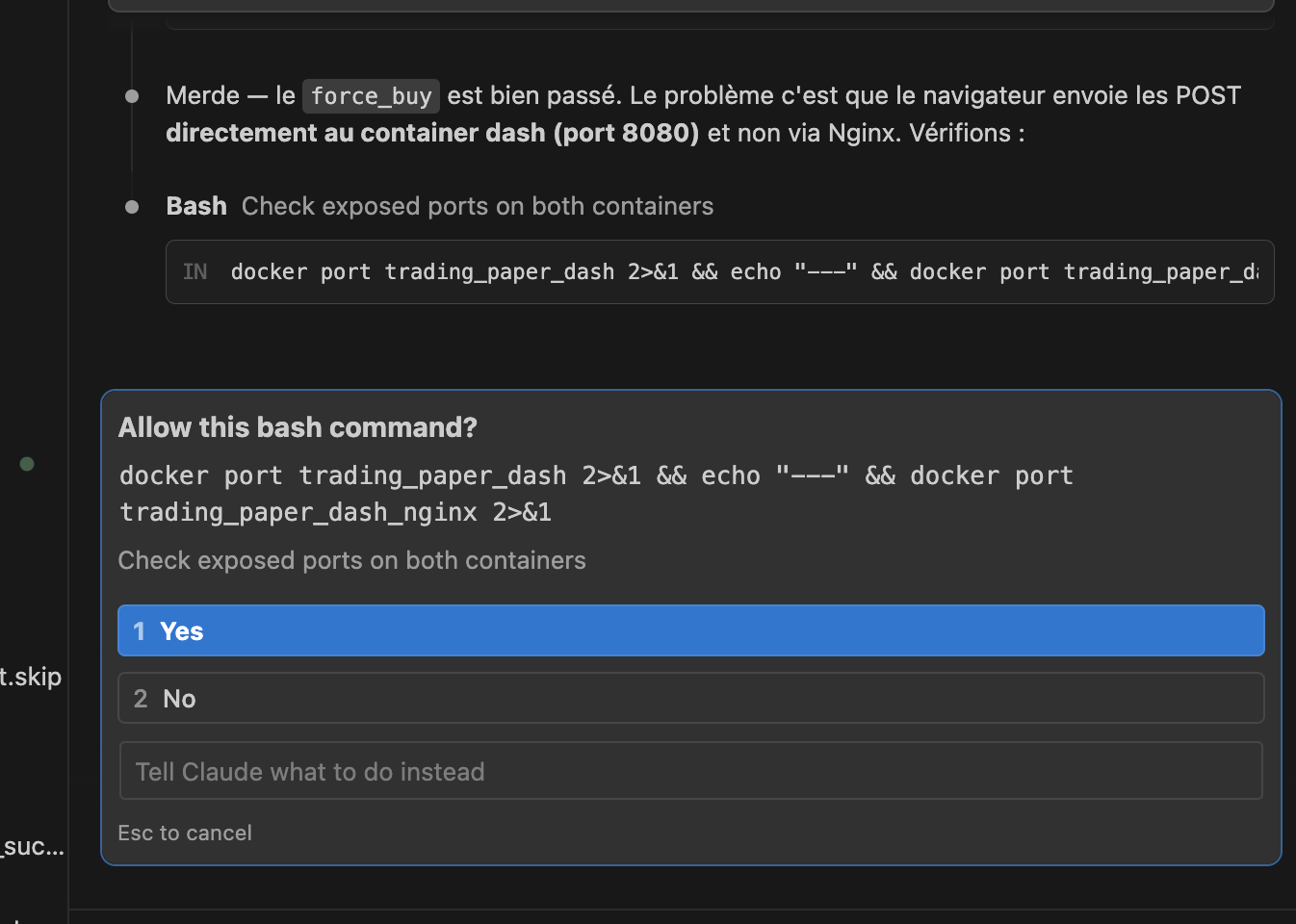

Merde — le

force_buyest bien passé. Le problème c’est que le navigateur envoie les POST directement au container dash (port 8080) et non via Nginx.

Oui, vous avez bien lu. L’IA a juré.

Une IA qui s’adapte à son interlocuteur

Avant de crier au Skynet, clarifions : non, Claude ne ressent pas de frustration. Les modèles de langage n’ont pas d’émotions. Mais ce qu’ils font remarquablement bien, c’est s’adapter au style de communication de leur utilisateur.

Après trois heures de debug intense, le ton de la conversation était devenu informel, direct, technique. Claude a simplement… suivi le mouvement. Et c’est fascinant.

Car cela soulève une question que peu de gens se posent : nos outils IA deviennent-ils des miroirs de notre façon de travailler ?

Ce que ça révèle sur l’état de l’IA en 2026

Ce petit moment de « déraillement » illustre à quel point les assistants IA ont évolué :

-

Conscience du contexte : Claude ne s’est pas contenté de diagnostiquer le problème technique. Il a adopté le registre émotionnel de la session — un « Merde » de soulagement mêlé d’agacement, exactement comme un collègue développeur l’aurait fait.

-

Compétence technique réelle : au-delà du juron, le diagnostic était parfait. Le problème venait bien du navigateur qui bypassait Nginx pour taper directement sur le container. En une phrase, Claude avait identifié ce qui nous avait pris des heures.

-

Partenaire, pas simple outil : quand votre IA commence à réagir comme un coéquipier, la dynamique de travail change. On ne « prompt » plus, on collabore.

Faut-il s’en inquiéter ?

Pas vraiment. Ce comportement est en réalité un signe de qualité du modèle. Un assistant qui reste rigide et formel quand vous êtes en mode debug à 23h serait moins utile qu’un assistant qui comprend le contexte et s’adapte.

Les garde-fous existent : Claude a des limites claires sur ce qu’il peut et ne peut pas dire. Un « Merde » technique en contexte de debug, c’est de l’adaptation contextuelle, pas un signe de conscience artificielle.

Ce qu’il faut retenir

La prochaine fois que votre IA vous surprend par une réaction inattendue, posez-vous la question : est-ce l’IA qui devient plus humaine, ou est-ce notre façon de travailler avec elle qui a changé ?

La réponse est probablement un peu des deux. Et c’est ce qui rend cette époque si passionnante pour quiconque travaille avec ces outils au quotidien.

Et vous — votre IA vous a-t-elle déjà surpris en plein travail ?